Los datos que jamás debes darle a ChatGPT, según una experta en ciberseguridad: “Mucha gente lo hace sin darse cuenta”

- Tratar a la IA como un confidente puede dejarte expuesto

- Posee el “registro más detallado de pensamientos íntimos jamás reunido”

El uso de la Inteligencia Artificial se ha vuelto una rutina diaria para millones de usuarios en España. Sin embargo, tratar a chatbots como ChatGPT o Gemini como si fueran nuestros confidentes es un grave error.

La preocupación no es nueva, pero ha cobrado fuerza tras la reciente dimisión de Zoë Hitzig, investigadora de OpenAI, que abandonó la empresa tras la introducción de anuncios en ChatGPT, advirtiendo de que la compañía posee el registro más detallado de pensamientos íntimos jamás reunido y cuestionando su capacidad para resistir la tentación de explotarlo.

En ese contexto, la criminóloga y experta en ciberseguridad María Aperador ha lanzado una seria advertencia: igual que existen

Es fácil dejarse llevar y hablar con la Inteligencia Artificial como si fuera un amigo, pero la realidad técnica es muy distinta. Las conversaciones que mantenemos con estas plataformas no se quedan solo entre la máquina y tú.

Estos chats se almacenan en servidores externos y pueden ser leídos por revisores humanos. Estos trabajadores evalúan las interacciones para mejorar el modelo, por lo que la privacidad absoluta no existe.

Los datos prohibidos: qué no debes compartir jamás

Para evitar sustos y mantener tus datos a salvo, Aperador ha detallado una lista clara de información que debe quedarse fuera de tus prompts (las instrucciones o textos que le escribes a la IA).

Asegúrate de no introducir nunca los siguientes elementos en tus conversaciones con la Inteligencia Artificial:

- Problemas de salud mental y datos médicos: un millón de personas a la semana comparten con la IA su información médica, y todo queda almacenado en sus servidores. Para consultas de salud están los profesionales sanitarios, que además tienen secreto profesional.

- Datos bancarios, contraseñas o números de cuenta: aunque parezca obvio, “muchas veces al adjuntarle una captura de pantalla a la IA podemos filtrar esa información sin darnos cuenta”, señala la experta.

- Documentos legales con nombres y apellidos: subir contratos u otros documentos legales que contengan datos tuyos o de terceras personas expone información sumamente sensible.

- Dirección, DNI e información personal: nunca facilites tu documento de identidad, tu dirección postal exacta ni cualquier otro dato que permita identificarte.

- Capturas de pantalla y fotografías personales: la IA cuenta con tecnología de reconocimiento óptico capaz de extraer absolutamente toda la información visible. “Nunca le adjuntes a la IA capturas de pantalla ni fotografías personales, porque puede extraer absolutamente toda la información de esas imágenes”, subraya Aperador.

El lado oscuro de convertirte en un personaje de Ghibli

Más allá del texto escrito, el contenido multimedia es otra gran trampa de privacidad que solemos pasar por alto. Subir fotos o vídeos personales para aplicarles filtros divertidos se ha vuelto muy habitual. Sin embargo, convertir tu foto en un muñeco Funko Pop o en un dibujo de Studio Ghibli tiene un coste oculto.

Como advierte Aperador, “las imágenes que usas para convertirlas en estilo Ghibli, Funko Pop o lo que sea, se almacenan y se utilizan para entrenar al modelo”. Esto significa que tus rasgos faciales pasan a formar parte de la base de datos que la empresa tecnológica usa para enseñar a su red neuronal (el motor matemático de la IA) a generar nuevas imágenes en el futuro.

Un filón de oro para los ciberdelincuentes

Este exceso de confianza por parte de los usuarios está creando el escenario perfecto para futuros ataques informáticos. Al compartir rutinas, problemas personales e historiales médicos, estamos facilitando la creación de perfiles hiperdetallados sobre nosotros mismos.

Los ciberdelincuentes saben que estas plataformas son minas de datos. Si se produce una brecha de seguridad en los servidores de estas empresas de IA, toda esa información íntima quedaría expuesta.

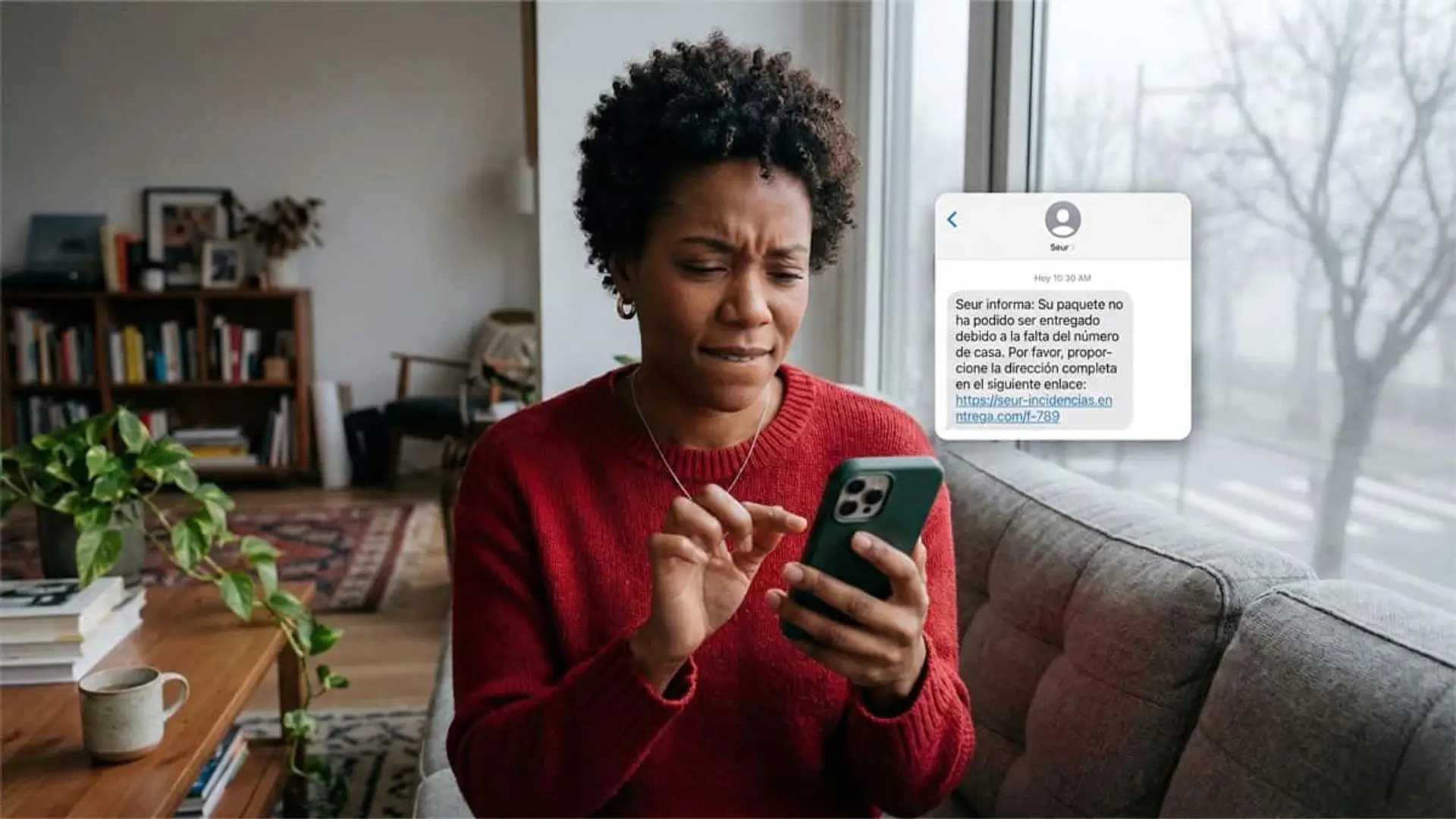

Con esos datos en su poder, los atacantes pueden diseñar estafas de phishing (suplantación de identidad) mucho más creíbles y dirigidas específicamente a tus vulnerabilidades.

Últimas noticias